AUI的构成元素:虚和实

AUI有2层涵义,一层是Augmented User Interface:增强的用户界面;一层是Augmented User Interaction:增强的用户交互。

我前面所说的AUI概念:“AUI应该是指有视觉或者确实深度信息的虚实结合的用户所见界面。是需要至少处理一种深度信息且和真实世界结合的用户所见界面”,严格来说是指它的第一层涵义。

在我描述的这个概念里有两个重点,一个是深度,一个是用户所见。

深度是AUI设计与屏幕UI最大不同的特点,这个深度是用户有直观感知的,不同于屏幕UI里单纯用投影、遮挡带来的前后感觉,而是能够带来距离感的深度,是能带给用户远近感觉的。或者更具体一点,是双眼深度信息(这个我在后面的部分会展开分享)。

用户所见是最后形成的界面,不单单是增强了现实的那部分界面,而是增强后用户所见的所有界面,即真实世界本身存在的,会被用户看见的画面,再加上增强的这部分虚拟内容,一起呈现给用户看见的界面。

我不用 Augmented Reality User Interface,而用了Augmented User Interface, 也是为了更加突显虚实结合这个结合后的画面。这个结合画面AUI里,体现着AUI的两个构成元素:虚和实。

虚,是虚拟图像,是屏幕视场角范围下的虚拟图像显示画面;实,是真实世界,是人眼视场角范围的整个画面。

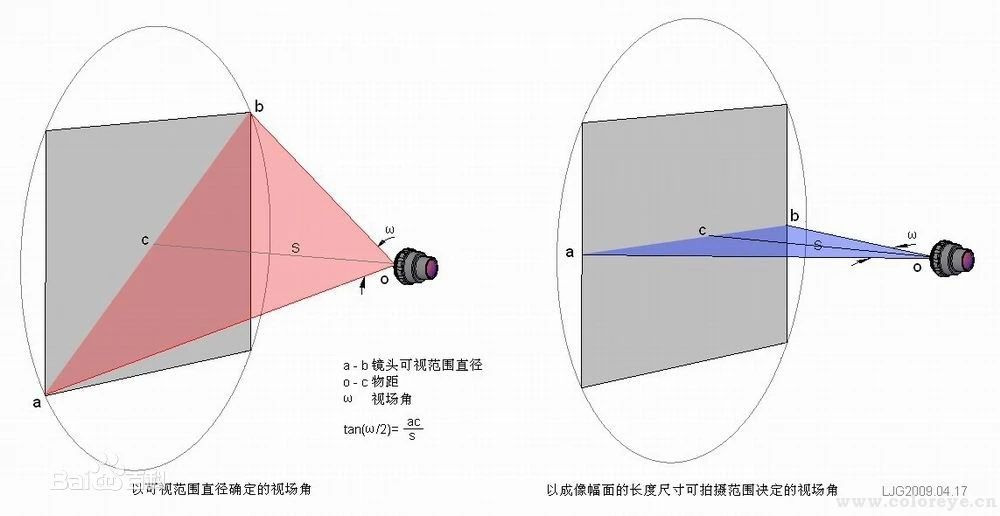

视场角,也叫FOV,Field of View。FOV有2个定义,在光学仪器中,以光学仪器的镜头为顶点,以被测目标的物像可通过镜头的最大范围的两条边缘构成的夹角,称为视场角。视场角越大,视野就越大,光学倍率就越小。也就是说,目标物体超过这个角就不会被收在镜头里。而在显示系统中,视场角就是显示器边缘与观察点(眼睛)连线的夹角。

AUI的两个构成元素虚和实,也就是两个FOV。

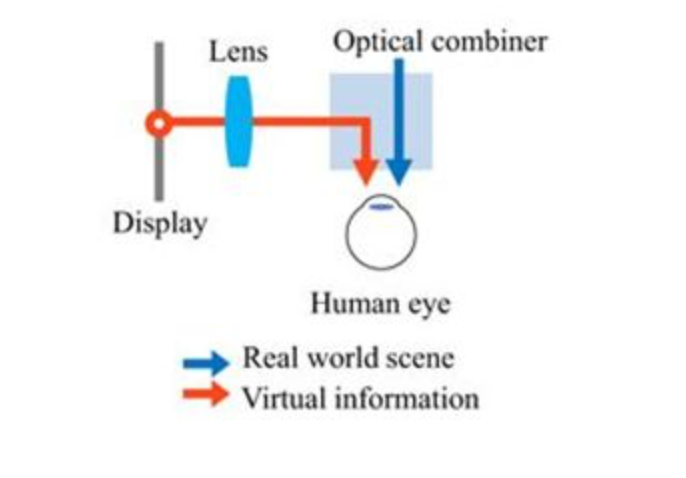

第一个FOV,是屏幕显示视场角范围下的虚拟图像,也就是上述所说的第二种概念,显示范围的视场角。以AR眼镜的硬件形态来说,整个光学系统的显示器可以简单表示如下图,是放在一侧的,视场角就是这个显示器经过折射后显示的边缘与眼睛连线的夹角。

图片来自SOHU《一文看懂主流AR眼镜的核心显示技术光波导》

图片来自SOHU《一文看懂主流AR眼镜的核心显示技术光波导》

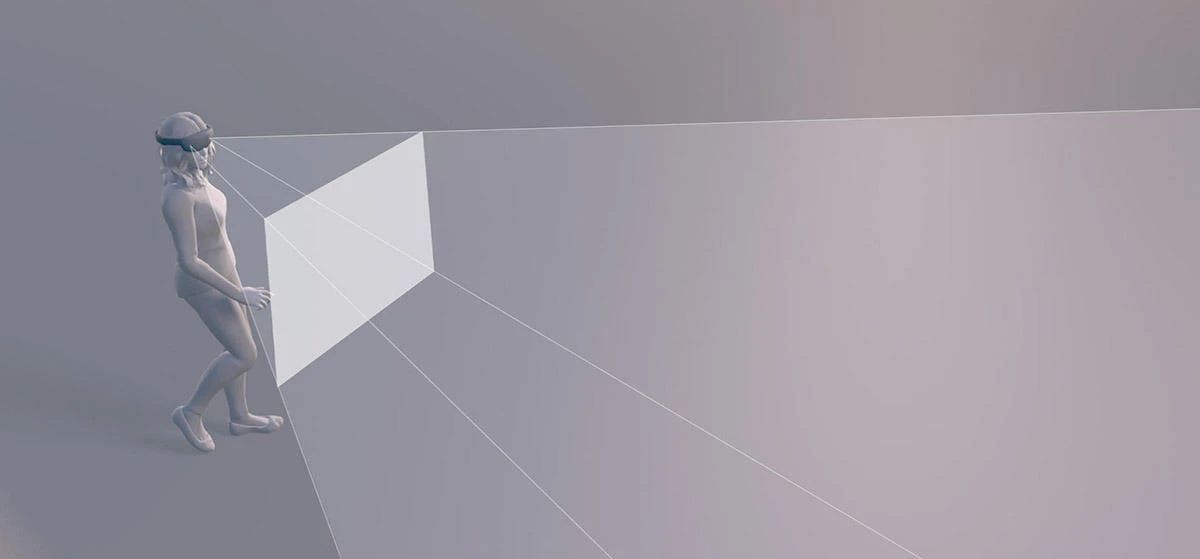

通俗来说,可以用下图来理解AR眼镜设备显示的FOV范围。

图片来自:Microsoft Hololens 网站

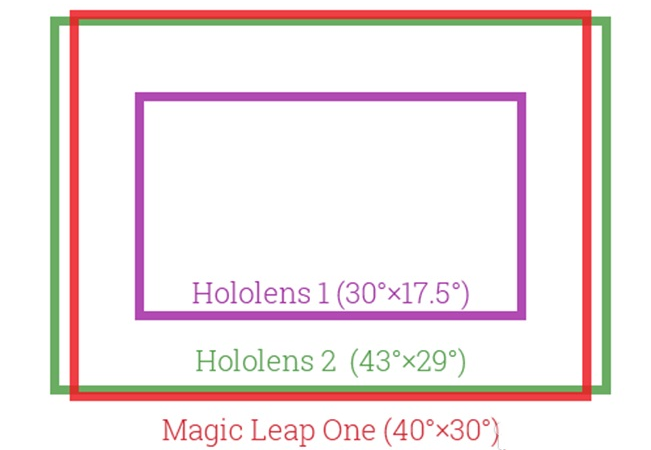

现阶段虚拟图像的显示屏幕,一般都小于人眼视场角。下图是业界比较有名的光学方案AR眼镜显示FOV,可以看到,即使是第2代的Hololens,视场角也只有43°✖️29°,而人眼的FOV,却可以达到230°✖️150°的范围。

http://www.vrzhijia.com/news/27271.html

两种FOV的差别,也就造成用户实际体验的时候,人眼所见的真实界面区域远远大于虚拟图像可以显示的区域。

也就是构成AUI的根本元素虚和实,是两种不同大小的画面。

要注意的是,由于视场角是一个根据深度变化的范围,如下图所示,所以在不同深度下的实际横切面积是不一样的,最终的呈现效果和比例也会不一样。

相比起纯视频流技术下的AUI,由于视觉上缺少屏幕或视频的边框分离,光学式技术方案下的两种构成元素:虚和实的区别会更明显。

设计的时候,我们直接设计的内容是构成元素中的“虚”,考虑的是理想的虚拟内容物在构成元素“实”中的虚实结合设计效果。

用唐纳德在《设计心理学3》里的概念来说,这个虚实结合是就是设计师的概念模型。而系统表象所呈现的,却是两个FOV下的虚和实。

我认为设计师始终需要的,是通过系统表象的虚和实,来和用户进行沟通。

原文:https://mp.weixin.qq.com/s/dWnbsxWFl2dvJE_UViksjw

既然来了,说些什么?