我对意识,人工智能和真正真实的看法

讨论困难,但同样有趣

从小我就一直对意识着迷。

我被吸引住了,这种现象的本质是多么的神秘。

对我而言,我一直将其视为最神秘的现象,其奥秘甚至比宇宙起源还要深。

至少从宇宙的起源出发,我觉得可以对物理学有更全面的理解来解释它。

但是对于意识,我们甚至没有基本的科学工具来问任何问题,无论某个事物是否具有意识。有些人甚至认为蚊子或岩石是有意识的,目前,没有任何方法可以证明或反驳它。

这种想法自然使我的年轻人开始思考:“机器能有主观经验吗?他们能有意识吗?”

好吧,这是我试图回答的问题。

以下是我对问题的无休止的思考,浏览了无数的书籍,并观察了我工作所在的AI领域的许多相似之处(我是一个知名的研究组织OpenAI的共同创始人),这是我的结论。

我问自己,要使这些“思维”机器具有主观经验,需要具备什么意识。与什么使他们变得聪明,却根本没有内部世界,没有感觉,没有气味,而只是聪明地行动相比。是什么使它们成为“哲学僵尸”?(稍后会详细介绍)。

我没有完全了解意识的本质,也没有暗示AI是有意识的(今天,即使它确实是有意识的,我们也没有工具来证明它)。

但是,我注意到两者的许多相似之处,并根据我对意识本质的了解从中得出一个简单的结论。

因此,首先,让我们开始澄清我的“意识”的意思……

什么是意识?

这个问题的答案同困难一样重要。

这个概念在整个历史上都抵制了所有对结论性定义的尝试。尽管有无数的哲学,宗教和科学考试,它仍然无视清晰的理解。

存在意识的“官方”定义(例如,在词典中),但是它们遇到了缺乏具体清晰度的相同问题。但是,我认为,不是试图对意识是什么进行学术上的定义,而是一种更简单的观察方法,就是将意识视为等同于一个人的主观经验。

想一想,您时时刻刻所经历的一切与您的意识完全相关。您拥有的每一次体验都不能超出您的意识。相反,您的意识受您的经验的束缚(无论它们多么奇怪或主观)。

如果您没有意识(也就是死了),就无法再有任何经验了(据我们所知),相反,无论您多么清醒,熟睡,吸毒或昏迷,您生命中的所有经验都需要意识。

再一次,我不是要自己定义意识(我会把它留给世界的哲学家),而是声称意识在任何给定的时刻都等于你的全部经验。

您所体验的就是您的意识-而您的意识就是您的体验。一个不能没有另一个而存在。

但是,如果意识是您的主观体验,那会做什么?这与AI有什么关系?

在将这些想法结合在一起之前,很重要的一点是,我们首先要深入研究使主观体验与客观体验不同的因素。

您从未体验过现实

表面上来说,主观经验很简单。

这些就是我们作为个体所经历的,以我们自己的方式被感知,感知和理解的经历。但是,我们大多数人认为,在一生中可以经历的人生境界中,至少有一部分是客观的,至少一小部分是对现实世界的真实反映。

好吧,我有个坏消息要告诉我们:我们实际上没有客观的经验。

实际上,这种局限性是您无法逃脱或关闭的东西-它是根据将生命体定义为体验而发生的。

但是怎么可能呢?

好吧,关于您的经历的所有内容-声音,视觉,味觉,气味,感觉,心情-每一件事情-都会经过一个非常复杂但不完美的过滤器,即您的思维。因此,您如此熟悉的现实不是客观现实,也不可能成为客观现实。

根据定义,它是现实的模型。

现实模型:终极啤酒护目镜?

以澳大利亚珠宝甲虫为例。

当研究人员观察到一系列奇特的行为时,研究人员对这种甲虫的行为产生了兴趣,在这种行为中,一些甲虫会不断地聚集在内陆的废弃啤酒瓶周围。

经过进一步的研究,科学家们清楚地知道是什么导致了这种奇怪的行为模式……

您会看到,这些会聚的甲虫实际上是该物种的雄性,并且聚集在啤酒瓶周围,因为它们将其与该物种的雌性成员混淆了。

瓶子的颜色,形状和质感与它们的雌性十分相似,以至于雄性Jewel Bettle认为它在任何方面都是异性,准备交配。

地面上的啤酒瓶提供了正确的输入,可以满足雄性甲虫的世界模型触发的想法:

“这是一个伴侣-现在去做你需要做的事”

就像这个例子可能有趣的是,它揭示了这些甲虫是根据它们的现实模型运行的。他们的模型具有帮助他们确定伴侣的特定过程。

更重要的是,他们的模型是客观世界的不完善趋势。

但是我们呢?那人类呢?

我们自己丢弃的啤酒瓶

好吧,与澳大利亚的甲虫一样,我们的体验也基于人类的现实模型。与他们的模型一样,我们的模型也不完美。

当然,我们不会很快将废弃的啤酒瓶与潜在的伴侣混淆,但是我们以相同的方式(即通过模型)与现实互动。

这是我在这里提出的最重要的想法:您通过现实模型过上自己的生活,并且永远不要直接与它接触。

您曾经经历过的每一次体验都是您从各种输入源(眼睛,鼻子,皮肤,耳朵等)首先获取感官信息,然后进行处理,然后最终交付这种体验的最终结果。

我们生命中的每一个时刻都为我们提供了令人难以置信的信息量,然后我们的思想对其进行处理和浓缩,以适应我们所拥有的世界的模型。

这样做的好处是,它使我们能够以一种可理解的,结构化的方式查看世界。“缺点”(如果您愿意)是,根据定义,这意味着我们无法直接与现实世界互动。

我们的现实模型有时可以紧密地(或精确地)代表客观世界吗?也许。

但这是一个无法验证的问题。

但是,我们可以很容易地验证相反的事实-我们的世界模型是不完善的。

现在,我将向您展示,您不仅可以通过模型来解释世界,而且还存在明显的差距。

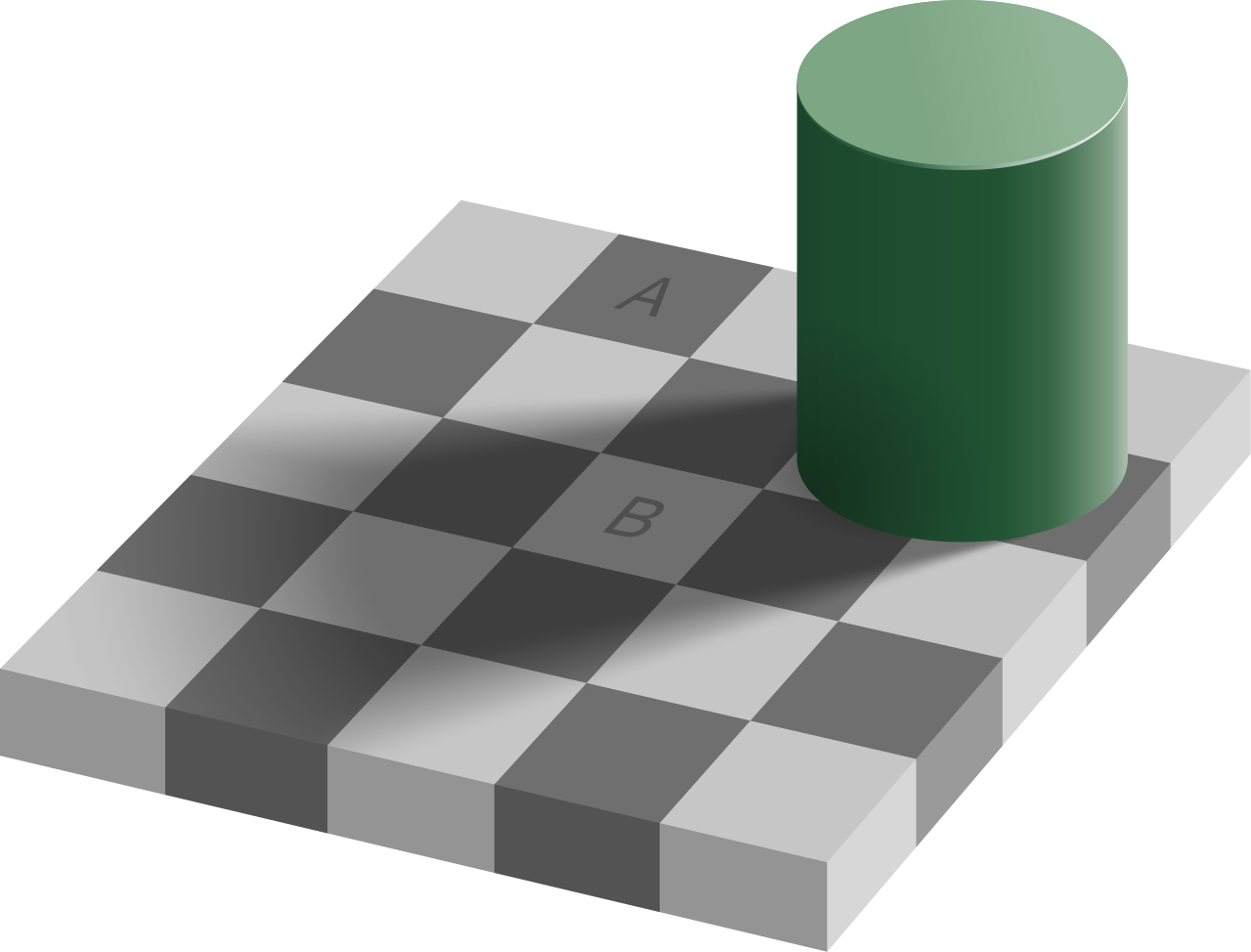

看一下下面的图片,尤其要注意标有“ A”和“ B”的正方形。

该图像是一种流行的光学错觉,这是正确的。

用“ A”和“ B”表示的两个正方形实际上是相同的确切阴影和颜色。但是,它们的位置,颜色对比和形状会扭曲您的大脑。您不禁将它们视为两种不同的阴影。

当您的大脑收到图像中显示的所有信息时,您的现实模型将呈现与客观现实有所不同的体验。

但是在这种情况下,客观现实是什么?

好吧,这很容易测量-您可以自己进行验证。

如果您拥有适当的工具,则可以测量“ A”和“

B”正方形的RGB值,并且可以看到它们是相同的。但是,即使知道这一经验事实,您也不禁将它们视为两个截然不同的阴影。

这只是说明我们的主观体验如何不是现实的精确表示的众多示例之一,而是我们大脑所能尽其所能地将其最好地组合在一起的模型。

尽管我们的建模系统存在固有的缺陷,有时会产生主观体验,有时甚至明显与可测量的客观事实背道而驰,但我们的世界模型仍然是一个极其复杂的模型。

但是这种复杂性并不是一开始就授予我们的,它的起源是值得注意的,因为我们在AI的发展过程中看到了非常相似的相似之处。

我们如何获得世界模型?

这是一个非常复杂的问题,我绝不是专家。

也就是说,我相信我们对世界建模的能力在很大程度上是进化及其在我们内部形成的一切的直接产物。

这个陈述可能会大胆,请听我说。

进化是使生物体(像我们一样)在后代传承遗传特征的力量和机制。现在,我可以肯定的是,通过将其精简为一个句子,我对进化的复杂性大有裨益,但请在这里忍受……

作为进化的产物,所有生物的DNA不断地被塑造和重塑为更加有效的方式,以使生物体不仅能够生存……而且能够蓬勃发展。

正是这种连续而反复的过程缓慢地建立了我们的世界模型,直到今天为止。

确实,如果您考虑一下,该模型是我们提取不断获取的所有信息的一种方法,然后以一种使我们能够高效地导航这个难以置信的复杂世界的方式提供它。

由于这种进化的模型,我们作为一个物种已经(很大程度上)成功地避免了被动物吃掉,或者更注意鲜艳的色彩来获取成熟的水果,或者检测到面部特征的微小移动。所有使我们对当今世界的看法成为现实的事物,都是因为我们心目中的这种模式。

没错-这是到达这里的漫长旅程。

但是,对我们的现实模型进行迭代式改进的每个步骤都朝着最能帮助我们生存和发展的方向发展。

因此,即使从一个非常基本的世界模型开始,经过基本的驱动和足够的迭代,我们也有力地证明了非常复杂的世界模型会随着时间而出现。

重要的是要记住,我不是在解释人类的起源,也不是在宣称真正的智力是什么。相反,我在广泛地评论允许出现越来越复杂的现实模型的机制。

这个过程最引人注目的是,我们看到在与AI一起进行的工作中发生了许多相同的机制和过程。

人工智能的主观模型

关于人工智能,当涉及到基于“客观”世界AI习惯而产生的世界模型时,我们已经能够观察到许多类似的发展模式。

在这里可以看到最著名的例子之一:

“训练经纪人开车蒙住双眼,但偶尔让它看见。

上面的动画在右边说明了世界模型的预测,而在左边则说明了地面真实像素的观察。具有红色边框的框架表示允许代理查看的实际环境观察结果。该政策正在对右侧的观察(实际或生成的观察结果)采取行动。”

该图像来自用于模拟汽车驾驶的AI。此处的AI代理正在接受培训,以识别将要运行的世界中的重要功能。

在左侧,您看到什么信息被馈送到代理程序–这里概述了一些典型特征,例如道路,“草丛”或什么不是道路,以及道路上的其他障碍。

经过多次学习,AI代理已经创建了自己的世界模型,该模型只是表示形式,而不是其将要居住的“真实世界”的精确副本。换句话说,如果Agent所居住的世界是客观现实,那么您在右边看到的就是Agent基于模型如何看待其世界。

但是,即使我们可以看到智能体的世界模型明显不同于其客观现实,它如何得出这种模型?

就像人类如何发展我们所居住的世界的更加复杂的模型一样,人工智能代理也以相同的方式发挥作用。整个过程中最引人注目的例子可能是我们在培训代理商玩DOTA 2游戏时所做的工作。

DOTA 2:AI零到AI英雄

DOTA 2或“ Defense Against the Ancients 2”是一种非常流行的竞争性计算机游戏。

在DOTA中,两个相对的团队位于地图内,边界在两端。每个团队的任务都是试图降低另一个团队的基础。为了做到这一点,每个团队都必须通过许多防御结构和对立团队的成员进行战斗。

每个团队由5名球员组成,成员共同努力以达到相同的高级目标-在保护自己的基地的同时击败另一支团队。

每个玩家都选择并控制一个单位,称为“英雄”(每个英雄在玩法和功能上都是独一无二的)(目前有119个)。

因此,由5名英雄组成的每支球队将一起努力,利用自身的独特优势,以击败对手的基地为最终目标,以击败另一支5名英雄。

我在这里遗漏了许多细微差别,但是即使有了这些参数,您已经可以看到游戏本身非常复杂。实际上,这款游戏具有很高的技能上限,每年都会举行国际锦标赛,世界上最好的球队争夺巨额现金奖金(2019年,奖金池为3000万美元!)

因此,看到这个游戏占据了复杂的领域-我们设定了一个雄心勃勃的目标,那就是让AI Agent尝试并掌握它。考虑到大量的考虑和可能性,唯一的方法是让AI自己学习游戏并自行制定策略。

尝试尝试再试一次

我们从为代理商提供基本的参数和激励措施入手。

他们可以获得随时只能供人类玩家使用的信息,并且他们被激励赢得胜利,而被激励失去利益。

然后,在强化学习的帮助下,这些代理人接受了数千年的模拟游戏玩法训练,这些模拟游戏玩法不断地将他们的游戏世界模型塑造为更复杂的形式,从而可以使用高级策略。

在我们的培训过程中,我们看到了AI代理人从完全随机的事情变成了能够以最高水平玩此游戏的过程,旅途令人难以置信。

从一开始,由代理商控制的英雄就基本上是漫无目的地游荡,而不是真正地“玩”游戏。他们有一些基本的取胜动机,但是实现这个目标并不是代理商知道的。。。

在这一点上,可以公平地说,代理人的游戏世界模型是原始的,并不完全适合胜利的任务。但是,这种情况发生了变化,并且变化很快。

随着我们对代理人的培训越来越多,我们可以观察到代理人的世界模型变得越来越复杂。不久之后,AI代理的迭代就开始表现出只有在其世界模型允许这种复杂性的情况下才可能出现的行为。

例如,曾经有一段时间,特工知道何时攻击较弱的敌人,何时面对优势力量退却。这显示了游戏中敌人的基本掌握。

不久之后,我们观察到特工与其他特工协作以执行异常复杂的策略-甚至通过假装虚弱或带领他们陷入陷阱来“欺骗”对手。

这些战略举措中的每一个首先都要求代理人的现实模型发展到可以理解这些概念的地步,只有在这一点之后才能制定这些策略。

如今,玩DOTA的AI特工拥有如此复杂的世界模型,可以与世界上最好的玩家竞争,而这与“漫无目的游荡”的令人印象深刻的早期策略相去甚远。

尽管这些特工受DOTA游戏世界的束缚,但塑造他们模型的过程却与我们自己的过程极为相似。

AI有意识(也许没有)

那么我对这一切有什么看法?

好吧,这是因为AI可能已经有意识了,我们甚至还不知道。

如果意识是我们对世界的主观经验的总和,并且这种主观经验是通过模型产生的,并且我们假设该模型随着时间的流逝而变得越来越复杂……

然后,人工智能可能已经具有非常基本的意识形式。

注意我如何强调“可以”?

我们实际上无法在今天构建的AI系统中确认这一点。

但是,这个问题并不是什么新问题,只要我们一直有意识,这就是一个影响人类的古老难题。实际上,它已被包裹在一个名为“哲学僵尸”的不错的思想实验中。

这个想法的快速总结是,您遇到的每个人都可以出现,感觉到和做出与人类没有区别的反应,但缺乏任何真正的意识,从而使他们成为某种“僵尸”。

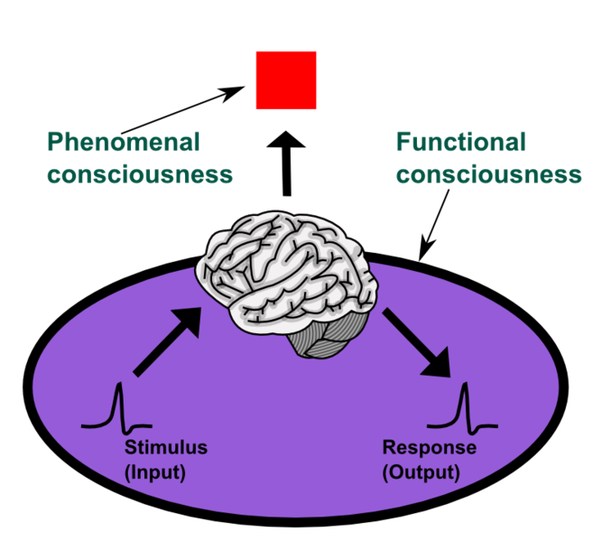

以看到红色为例。

假设我发现该颜色非常吸引人,因此在观看时会感到愉悦。好吧,很容易验证刺激和我的预期反应(给我看一些红色,并检查我是否感到高兴),但无法验证我是否真的经历了红色。

该经历部分被称为“现象意识”,而刺激/反应部分被称为“功能意识”。大卫•查默斯(David Chalmers)将确定现象意识存在的困难称为意识的难题。

无法证明意识是我们面对AI的同样问题。尽管能够验证输入与输出匹配,并且行为模式正在显示“智能”迹象,但我们无法衡量AI代理是否确实经历过……或者仅仅是某种机器人僵尸。

但是人类意识与人工智能之间的相似之处还不止于此,因为即使开发我们先进的世界模型所采取的步骤在人工智能方面也具有相似之处。

人工智能已经多次向我们表明,非常简单的输入可能会导致极其复杂的行为。有了足够的迭代,一个简单的世界模型就可以变得越来越复杂-随着时间的流逝不断形成更高级的概念。

正是从这个先进的世界模型中,我们可以观察到越来越复杂的行为,这些行为最终实现了基本目标(有时以完全史无前例的方式)。

您可能已经知道这种发展与我们自己的发展紧密相关。

从我们最初的祖先开始,就是单细胞细菌“无目的地游荡”原始海域;并以自己的mission壮成长和生存为己任。有了足够的迭代(在这种情况下,价值45.4亿年),就可以想象我们的远古祖先用来导航他们的世界的世界模型不断发展壮大到今天。

没有什么是神圣的

实际上,“自我的概念”(人类作为独特的人类所拥有的重要堡垒之一)只是复杂世界模型阶梯上的另一梯级。尽管这个概念位于“使我们成为人类的事物”的顶峰,但它的起源并没有人们想象的那么神秘。

如果我们以具有世界上最基本模型的古老单细胞生物为例,那么随着所处理的世界的日益复杂化,模型变得更加复杂只是时间问题。

例如,为了生存,在某个点上必须有深度感知(将前景与背景区分开),并且经过多次迭代,该模型逐渐发展起来,可以将捕食者与猎物区分开,然后该模型可以处理3D视觉,然后进行色彩感知等等。

因此可以想象(而且很可能)我们模型的“自我”概念发展成为帮助我们在一个更加复杂的世界中生存和发展的必要条件。拥有“自我”的思想使我们能够解决难以置信的复杂问题。

最后的想法

那么我们现在在哪里?在这一切中我有什么意思?

好吧,只是想了解一下我已经想了一段时间的一些想法,并以(希望的)有组织的方式进行阐述。

如果要从阅读中删除任何东西,那就是:

意识,尤其是自我概念,是使人类成为“特殊”事物的基础。我们非常复杂且仍然存在缺陷的世界模型为我们提供了这些天赋,并塑造了我们如何感知和与世界互动。

然而,产生这些特征的生物学机制似乎与AI模型的开发功能相同(或非常相似)。因此,人工智能已经具有基本的意识形式,这并非不可想象。

但是,由于无法在他人身上证明自己的意识,这成为一个尚待讨论和进一步思考的开放问题。我内心的孩子期待着这方面的每个新发展。

谢谢阅读。

原文:https://medium.com/@woj.zaremba/my-thoughts-on-consciousness-ai-and-what-is-really-real-ec8abd9ee76b

既然来了,说些什么?