6大主题回顾AI圈儿的2020

今天的吴恩达,举着热乎乎的咖啡杯,坐在一棵圣诞树前,为人工智能的2020做了一期回顾。

Andrew says,「无论以什么样的眼光去回顾2020,它都可以载入史册。一种新的、传染性极强的病毒暂停了生活的车轮,社会的裂痕威胁着我们共同的利益。

机器学习工程师们,作为线上生活的艺术家,他们设计了新冠病毒的诊断和治疗工具,建立了识别仇恨言论和虚假信息的模型……

但他们展示了程序员们更轻松诙谐的一面:可以把睡衣换成西装的在家办公工具、妙趣多多的语言模型,以及人工智能辅助艺术和表演的有趣实验。

2020就要过去,请与我们一起回顾过去一年的艰辛与辉煌。」

让疫情散退吧!

突然起来的疫情,打得人们措手不及!

但不得不承认,有了人工智能的存在,我们加快了寻找冠状病毒疫苗的脚步,并在某些方面对疫情进行了降维打击。

世界各地的机器学习研究人员争相利用这项技术对抗冠状病毒。在许多失败的案例中,他们在检测、接种和其他领域取得了重要的成功。

全球传染病监测的数字健康公司分析了重大事件的新闻报道,在全球健康监测员提早几天发现了大流行,并向其客户发出了预警。

在巴黎和戛纳的公交车站,公共汽车和市场中使用计算机视觉评估了掩盖法规的遵守情况。政府培训了一个模型,以识别卫星图像中的赤贫地区,指导将救济金分配给最需要的人。

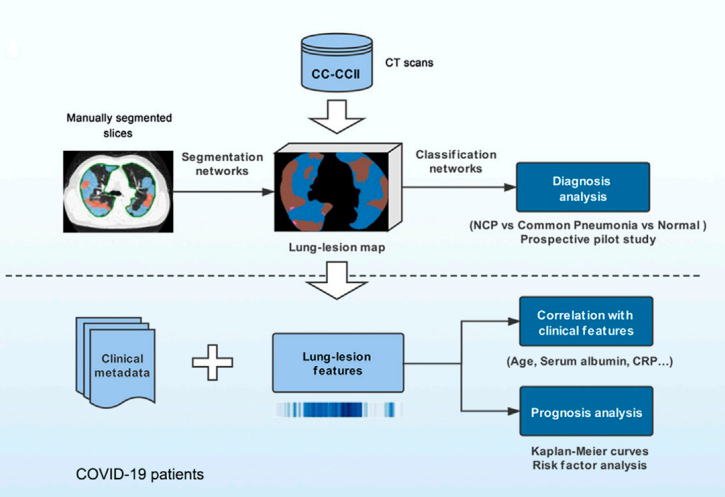

中国许多机构之间的合作开发了一种可在CT扫描中检测Covid-19的模型,其准确度超过90%。该模型已在七个国家/地区部署,到目前为止,该代码已下载了300万次。

美国生物技术公司,使用机器学习来优化mRNA序列以转化为可以测试的分子。

但是,人工智能不是灵丹妙药,但这种新型、毒性强、传染性强的冠状病毒株的出现,是对人工智能抗击传染病能力的一次令人振奋的测试。

GAN,让「像素世界」没有尽头

当有生产力的对抗性网络渗透到文化、社会和科学领域时,它们悄悄地将互联网转变成了一个无底洞,里面全是你能想到的合成图像……

它出现在主流娱乐、商业、政治活动中,甚至是一部纪录片中,用来保护屏幕上的证人。

受2019年的《这个人不存在》(This Person Does Not Exist)这款产生逼真个人肖像的网络应用的启发,有幽默感的工程师实现了生成对抗网络(GANs),模拟现实世界的细节。这里列举了一些受欢迎的:

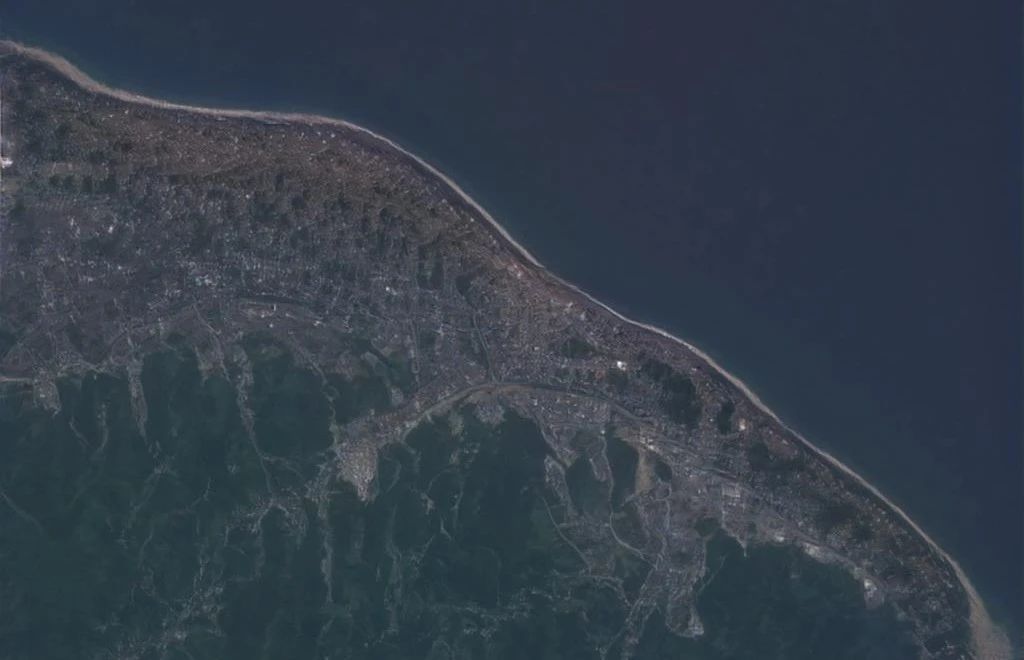

根据谷歌Earth的图像,这个不存在的城市产生了大大小小的定居点的鸟瞰图。

这匹不存在的马力,产生各种各样的姿势,品种,和情况。当然,它偶尔会吐出一团可怕的乱麻,但这就是乐趣的一半。

像许多「GANs披萨」一样,虽然这个披萨的奶酪缺乏粘稠的光泽,它的酱汁很少有活力,它的面包皮看起来不够烤熟。但是,正如谚语所说,即使是糟糕的披萨也仍然是披萨。

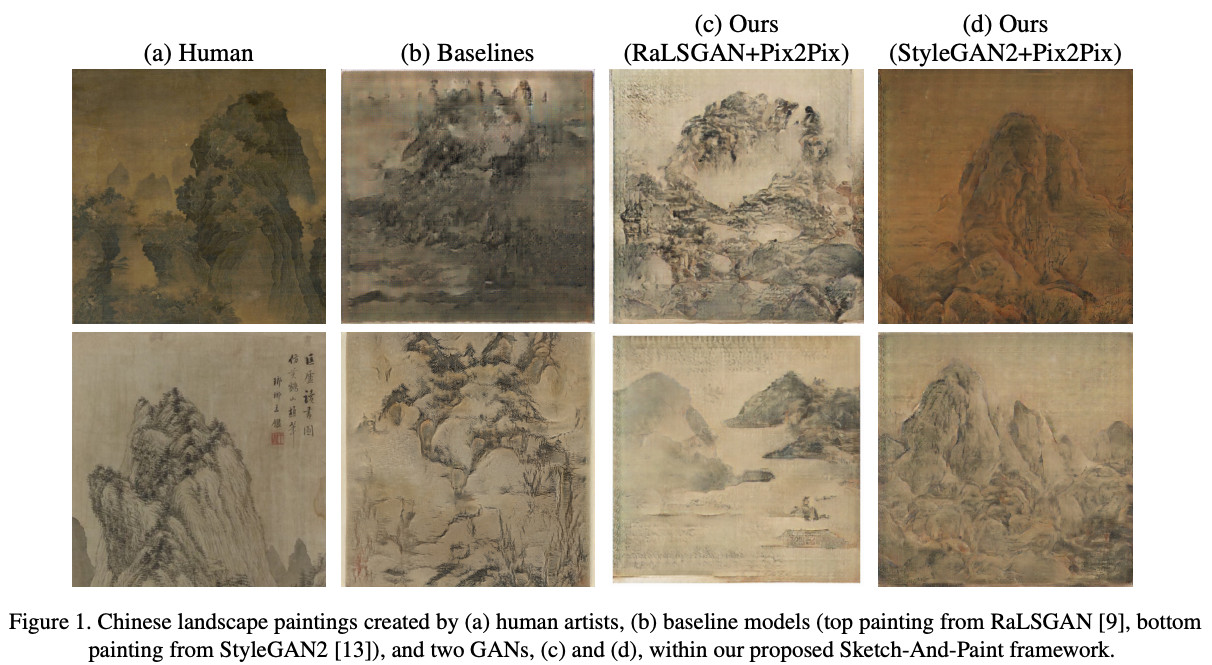

普林斯顿大学的本科学生Alice Xue在她的毕业论文中,开发了一款名为SAPGAN(Sketch-And-Paint GAN)的AI模型,该模型可以生成传统的中国山水画,为此她也获得了普林斯顿2020优秀毕业论文奖。

但一些观察人士担心,人工智能制造的假货可能会破坏信任。但这项技术仍至关重要。

说到这里,GAN 之父——Ian Goodfellow,在本科和博士早期阶段曾经多次向吴恩达寻求建议。

别让肤色和种族失了语:为少数派发声

研究人员发现,由于数据集编译、标记和使用的方式,流行的数据集会向训练过的模型传递对社会边缘群体的偏见。

图像收集是焦点——包括计算机视觉基础数据集ImageNet。

ImageNet创始人李飞飞和他的同事们梳理了古老的数据集,删除了从WordNet(一个可以追溯到20世纪80年代的词汇数据库)继承来的种族主义、性别歧视和其他有辱人格的标签。

一项研究发现,即使是在未经标记的ImageNet数据上训练的模型,也能从数据集有限的人类多样性中产生偏差。

麻省理工学院计算机科学与人工智能实验室在外部研究人员发现该数据集充斥着贬损的标签后,撤回了该微型图像数据集。

说到这里,不得不回顾一下今年AI圈儿里那场著名的「骂战」:PULSE算法。

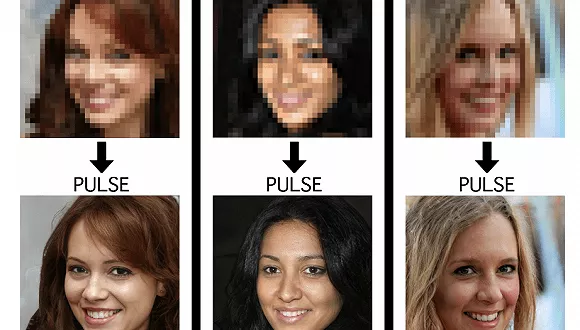

该算法由杜克大学推出,可以将模糊的照片秒变清晰,效果出奇的好。这项研究在CVPR 2020上发表。

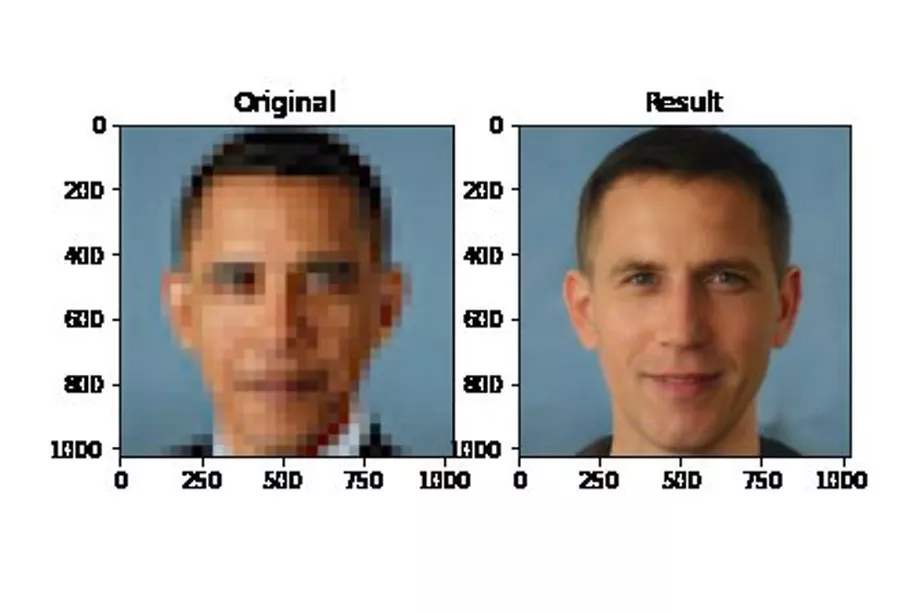

效果大概是这样的:

这本来是一项挺不错的技术,但是一次试验却引发了争议。

用于训练StyleGAN的数据集FlickrFaces-HQ (FFHQ)显然也缺乏足够的多样性。当基于StyleGAN的模型PULSE提高低分辨率照片的分辨率时,这个问题就出现了。PULSE将奥巴马的像素化图像调高为白人肖像。

种族歧视的强烈反对者却认定Yann LeCun有「严重的种族歧视」。

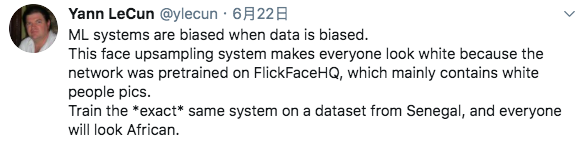

Yann LeCun立马对于PULSE算法的不完备性进行了解释:

简而言之,这种偏差是由于数据集导致的。PULSE所用的数据集大多都是白人,因此还原这张照片的时候出现了肤色误差。

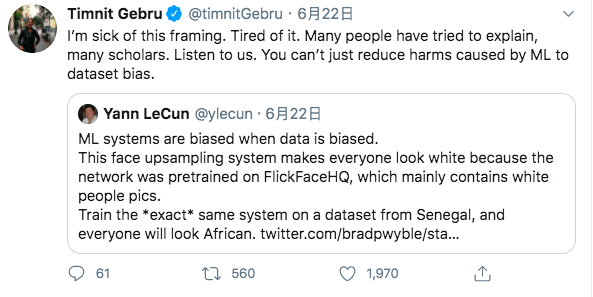

斯坦福AI Lab成员、Google AI科学家Timnit Gebru都明确表示:对LeCun表示「失望」。

Timnit Gebru指责Yann LeCun把问题归结于数据集而回避了「种族歧视」的问题。

在骂战持续了两周之后,Yann LeCun以「退出推特」的行为亲手为这场科研界的政治风波画上了句点。

这是一个无法回避的问题,但为了消除种族偏见,我们的「战斗」才刚刚开始。

NO FAKE!抵御虚假信息的算法

疫情、大选,都激起了一场自动虚假信息风暴,一些大型人工智能公司陷入了这一旋风。

6月,《华尔街日报》 报道说,一些Facebook高管使用了压制性工具来监管极端内容。该公司后来推翻了选举期间进行的算法更改,从而增加了知名的新闻来源。人们对Facebook的努力感到三心二意的看法促使一些员工辞职。

YouTube针对虚假信息进行的算法调整已成功减少了宣传虚假信息的内容创作者的访问量。但是,它们也增加了对经常传播相同可疑信息的大型实体的访问量。

用户AI照亮医疗

今年受到疫情的影响,人工智能在医学领域的障碍开始减少,为深度学习在医疗设备和治疗中的广泛临床应用创造了条件。

DeepMind 的 AlphaFold 模型在数小时内就确定了一个蛋白质的三维形状,因为有望高效开发出新的药物而成为了焦点。

与此同时,医疗机构也采取了新的做法,将这些AI技术带入主流的医疗实践中尝试。机构的这种变化促进了医学人工智能的发展,并且预示着它将要被越来越多的人所接受。

例如,美国最大的医疗保险公司Medicaid and Medicare就会对使用某种机器学习设备的医生进行一定的补偿:Viz.ai的VizLVO就可以在病人中风的时候,及时的提醒医生。同时,FDA还批准了几种新的基于人工智能的治疗方法和设备,

不过,目前很多应用都需要医院重新组织工作流程,这在一定程度上减慢了普及速度。一旦他们通过了 FDA 和医疗保险,临床医生就有了更大的动力去做出必要的改变来充分利用AI。

Natural language processing大进化,作家解脱了吗?

随着用于NLP的神经网络变得越来越大,越来越多产,结果也越来越有趣。

语言模型(LM)现在已经发展到了巨大的规模,并且还在继续变大。

OpenAI 的1750亿参数的文本生成器 GPT-3比它的前身 GPT-2写得更加连贯,以至于有骗子用它来创建博客或者和历史人物对话。

语言模型也促进了一些商业工具的发展,例如帮助苹果公司的autocorrect来区别不同语言之间的差异, 使得亚马逊的 Alexa可以注意到谈话的变化。

在语言模型中,越大越好这句话并没有错,但并不仅限于此。

iGPT预示着模型可以同时训练图像和文字。至少 OpenAI 正在研究的这些模型,可能比2020年的巨型语言模型更聪明、更奇特。

以上,就是吴恩达发布在the Batch上的2020总结文,最后:附上吴恩达开篇的一段话,这位人工智能专家对我们进行了鼓励。

在过去的十年里,每年的12月22日,我都会飞到新加坡或香港,和母亲一起庆祝她的生日。今年,我们第一次通过 Zoom 实现了这一点。尽管距离遥远,但我感到温暖,因为我的家人可以从美国、新加坡、香港和新西兰聚集在一起,唱一首同步性很差的「祝你生日快乐」。

我希望我也可以与你们每一个人在一个极速电话祝愿你们节日快乐和一个更快乐的新年!

在假期里,我经常想想我生命中重要的人的名单,回忆他们为我或其他人做了什么,并默默地感谢他们。这让我感觉与他们更加紧密相连。也许你会发现,在我们许多人都会有的社会距离假期里,思考这个问题也是很有价值的: 谁是你生命中最重要的人,你有什么理由去感激他们?

无论是面对面的还是在线的,我希望你能找到方法在这个假期里培养你最重要的人际关系。

Keep learning!

Andrew Ng

参考链接:

https://blog.deeplearning.ai/blog/the-batch-biggest-ai-stories-of-2020-covid-triage-fun-with-gans-disinfo-whack-a-mole-gpt-superstar-imagenet-recall-fda-approvals

既然来了,说些什么?