飞桨EasyDL助力资讯网站实现信息自动分类

写在篇首:EasyDL NLP内置文心·NLP大模型,业务冷启动阶段仅需少量数据即可获得产业级AI模型,助力业务快速落地。文心·NLP大模型面向语言理解、语言生成等场景具备超强语言理解能力以及对话生成、文学创作等能力,行业应用性及适配性好。本文将从文本分类任务开启,基于资讯类网站遇到的信息分类案例,为大家讲解EasyDL NLP的典型应用场景~

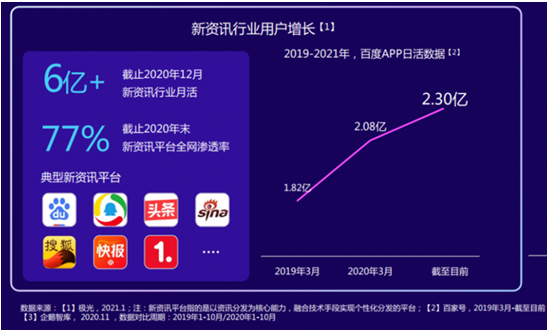

资讯类平台发展趋势:

Feed流普及助力资讯类应用活跃增长

随着移动互联网的发展,尤其是Feed流这种阅读方式的普及,丰富了用户自生产信息的渠道,资讯信息应用的活跃度指数更是呈现一个指数级的增长。

那什么叫Feed流的普及应用?下图即是一种交互形势:

通过为用户自动并主动寻找其感兴趣的内容,把内容精准推送到符合这一标签的用户画像群体当中,这就是Feed流的一种信息阅读方式。

随着这种方式的普及,很多耳熟能详的资讯类的应用,如百度APP、腾讯新闻、今日头条、新浪、搜狐等新闻资讯网站及APP,逐渐使用Feed流助力平台整体扩大推广路径。

在这种背景下,资讯类平台每天接收及处理信息的数量也在飞速增长。

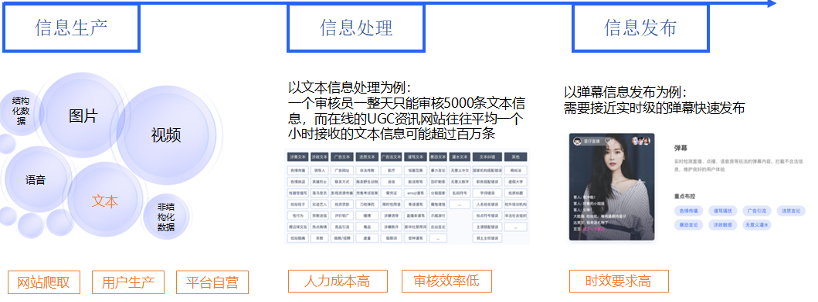

以资讯类平台的信息从生产到发布的全流程来讲,可概括为三步骤:

第一步:信息生产。作为资讯类应用,资讯生产的来源是多种多样的,主要包括以下三个部分。

- 网络爬取:比如,网上相关联的优质内容,我们可以通过自动化抓取策略,自动展示在资讯类应用网站的内容推送中;

- 用户自生产:类似于抖音、小红书等,更多资讯内容来源于UGC内容输出构成;

- 资讯类网站:有专业的运营/宣发团队进行内容信息处理。他们需要处理大量图片、语音、视频,文本信息。

第二步,信息审核。作为专业的资讯平台,需要多轮审核以确保UGC信息合规。审核的纬度包括:有无敏感词,爆恐词,违禁词,广告词等。之前通过人工方式来审核,以一条文本审核的效率为例:一位审核员一天最多情况下只能审核五千条的文本信息,而一个在线的UGC资讯网站,平均一小时接收的文本信息就可能超过百万条,如果还是用人工逐一筛检,效率非常低,这是在资讯平台信息处理中常见的痛点。

第三步,信息发布。以下图右侧案例:直播间用户发布弹幕文字信息为例。在这种发布情况下,对时效要求极其高,接近实时级审核,并完成推送。弹幕需要快速发布,才有直播互动的意义。

从上述信息发布的过程中,我们可以看到AI能够发挥作用的空间很多,尤其突出在内容分类、分析及内容审核三部分。本文将重点讲述资讯类平台是如何运用AI快速实现的标题/文章分类。

资讯类平台如何利用AI实现信息自动分类

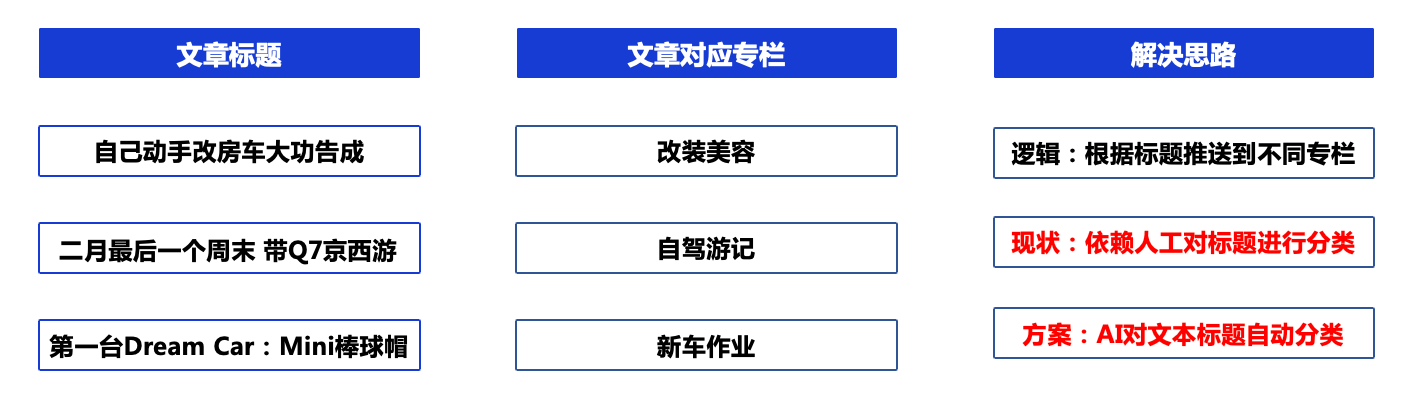

某汽车资讯平台在汽车业务、汽车采购、汽车车友组织等方面有多年的垂类行业经验积累,但在AI算法领域尚无技术积淀。但目前企业遇到实际业务问题是:面对大量汽车资讯类内容,部分来自用户UGC生产的内容、部分来自平台、自运营频道打造的专项精品的内容,也有来自定向合作伙伴网站抓取的内容。

作为这家汽车资讯平台,他们需要对以上所有内容进行快速分类、审核并推送到不同专栏下。

然而,作为汽车资讯专栏,常见内容多是涉及汽车的改装美容、自驾游记、新车作业、购车优惠等更加垂类的内容。而市场上针对这类文本的分类解决方案几乎没有。

汽车资讯平台标题分类

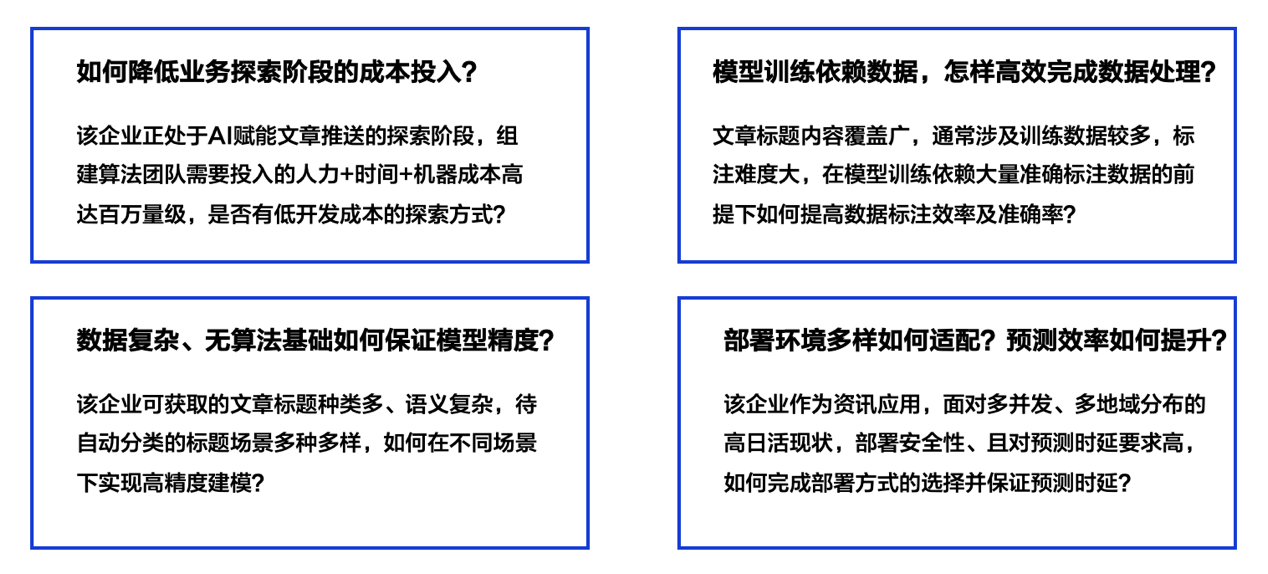

企业前期尝试通过组建算法团队满足业务需求,但评估下来发现投入的成本非常高。组建算法团队、匹配的机器资源,运维人员的到位,综合成本需达到百万级。而企业的核心诉求是希望能够降低前期的投入,利用AI赋能文本分类场景,提高文章发布的效率。而AI实现自动文本分类实践中会遇到以下几个问题:

以上业务问题,采用飞桨EasyDL零门槛AI开发平台迎刃而解。

成本控制:如何降低业务探索阶段的成本投入?没有算法基础是否也能利用AI解决业务问题?答案是肯定的。飞桨EasyDL零门槛AI开发平台就很够很好解决这一问题,用户可在公有云平台上进行AI模型训练,无需算法基础也可流畅体验。基于EasyDL节省了包括机器资源、人力、时间等在内的百万级成本。

数据处理:模型训练依赖数据,怎样可以高效的完成数据处理。如果是常规模式,需要依赖大量准确标注数据才有可能确保模型训练效果。而使用飞桨EasyDL,只需前期采集一千条以下的原始数据并完成标注,就可获得高精度产业应用模型。同时,EasyDL提供的高效率标注工具:智能标注,可以在只标注30%数据前提下,完成整体数据处理工作,大幅提升效率,节省70%的人力。

模型精度:如何确保模型精度?在EasyDL文本中内置百度文心·NLP大模型,对于没有AI基础的用户来说,在业务冷启动阶段,训练数据不充足的情况下,可以确保少量数据(20余条)进行训练即可获得产业级的AI模型;此外,在模型核心的筛选指标部分,提供多种业务逻辑可选择,在召回率和准确率取得一个平衡的综合指标,既可保证模型的高精度,也可保证能够在一定的召回情况下,减少机器审核完毕后,人工再来复核的成本。

部署调用:模型训练完毕后去部署,需要形成可调用的服务且保证服务的稳定性。尤其作为一家汽车资讯类网站,用户来自天南海北,同时浏览资讯的高并发业务场景非常普遍。这需要非常安全稳定的服务部署机制,用以保证线上用户的稳定调用。通过飞桨EasyDL生成的公有云的API,它可以有效的解决以下两个问题:

- 可以无缝集成到业务系统当中。提供已经封装好的HTTP的接口,直接就可以将接口运用到APP开发或者网页的开发中;

- 灵活的扩缩容的机制。针对业务实际应用的场景,在不同的时间段匹配不同的机器资源,避免在资源紧张期资源不够用。同时,在业务需求并非高并发时段,通过灵活调整机器份额的方式,省去机器资源的耗费。

最终,在整个项目中仅用2-4周完成AI文本模型开发及上线,比传统的开发成本整体降低90%+。

原文:https://mp.weixin.qq.com/s/fFdTSEUUJjSu6ltjBnNHkw

既然来了,说些什么?